站长之家(chinaz.com)5月16日 消息:uiuc与bigcode组织的研究者们最近发布了starcoder2-15b-instruct,这一创新成果在代码生成任务方面取得了显著突破。这款模型成功超越了codellama-70b-instruct,登上了代码生成性能榜单之巅。

starcoder2-15b-instruct的独特之处在于其纯自对齐策略,整个训练流程公开透明,且完全自主可控。通过自我生成数千个指令-响应对,直接对starcoder-15b基座模型进行微调,无需依赖昂贵的人工标注数据,也无需从商业大模型中获取数据,避免了潜在的凯发游戏的版权问题。

在humaneval测试中,starcoder2-15b-instruct以72.6%的pass@1成绩脱颖而出,较codellama-70b-instruct的72.0%有所提升。在livecodebench数据集的评估中,这一自对齐模型的表现甚至超越了基于gpt-4生成数据训练的同类模型,证明了通过自身数据训练的大模型同样能够有效地学习如何与人类偏好对齐。

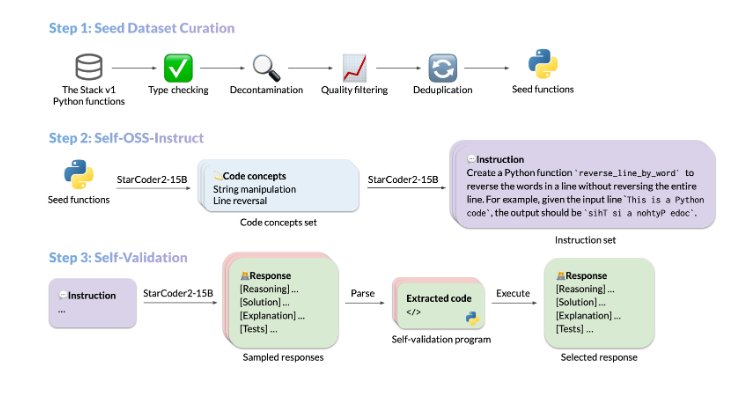

starcoder2-15b-instruct的数据生成流程主要包括种子代码片段的采集、多样化指令的生成和高质量响应的生成三个核心步骤。种子代码片段的采集是通过从开源代码片段中选取高质量、多样化的种子函数开始的。然后,基于这些种子函数的不同编程概念,starcoder2-15b-instruct能够创建出多样化且真实的代码指令。最后,通过自我验证的方式确保生成的响应是准确且高质量的。

starcoder2-15b-instruct在备受瞩目的evalplus基准测试中表现出色,超越了规模更大的grok-1command-r 和dbrx,并与snowflake arctic480b和mixtral-8x22b-instruct等业界翘楚性能相当。此外,在livecodebench和ds-1000等评估平台上也展现出了强大的实力。

该项目的成功实施得到了美国东北大学arjun guha课题组、加州大学伯克利分校、servicenow和hugging face等机构的鼎力支持。

starcoder2-15b-instruct-v0.1的发布标志着研究者们在代码模型自我调优领域迈出了重要一步。这款模型的成功实践展示了通过自我调优同样能够构建出性能卓越的代码模型。同时,该模型的开源数据集和训练流程为未来该领域的研究和发展奠定了坚实的基础。

模型地址:https://huggingface.co/bigcode/starcoder2-15b-instruct-v0.1